O post Como usar lapela? 4 Dicas essenciais para usar o microfone de forma certa apareceu primeiro em Luz, Câmera e ação! .

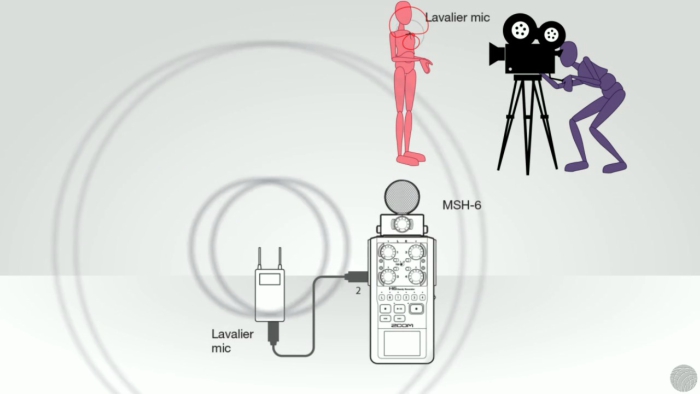

]]>1. Como usar lapela com Microfones Boom

Os microfones lapelas podem ser uma alternativa adequada para microfones boom se eles puderem ser completamente escondidos da câmera e o ator não precisar realizar nenhum movimento significativo durante a tomada que possa criar ruído de vibração. Vamos falar sobre como esconder o microfone um pouco mais pra frente.

O maior problema com a mistura de microfones de lapela e boom são os problemas de fase. Se as ondas sonoras de um microfone boom e um microfone lapela estiverem fora de fase, o resultado pode ser um cancelamento dos sinais, isso resultará em uma gravação com som vazio. A solução é inverter a fase de um dos sinais. Quando vários microfones são usados, o faseamento pode se tornar um pouco mais complicado e você pode precisar de algum tempo na pós para ter certeza de que todos os microfones em sua mixagem correspondem à fase.

2. Colocação de lapela em atores

Como usar lapela em entrevistas? Você pode prender o lapela diretamente na pessoa, prendendo-o a uma gravata ou na altura do peito e com o cordão visível. Para uma aparência mais limpa, o cabo do lapela pode ser enrolado dentro da camisa do sujeito, se você não se importar em ver o microfone na quadro, é uma ótima maneira de obter um bom som e uma configuração rápida.

Microfones lapelas devem ser colocados bem próximos à boca da pessoa, logo acima do peitoral. Naturalmente acontece do lapela deslizar na direção do umbigo, fique atento nisso, pois a qualidade do som desce junto com ele, já que se afasta da boca.

Como os lapelas nos filmes estão quase sempre escondidos sob as roupas para esconder o fato de que a pessoa está com um microfone, infelizmente há a possibilidade de algum tecido arranhar o microfone. Para minimizar isso, envolva a cabeça do microfone em uma fita, como moleskin, ou coloque-o dentro de uma hush lav.

Os Hush Lavs são cilindros de espuma que você coloca sobre o lapela, ele impede que o tecido bata nele e faça sons de arranhões:

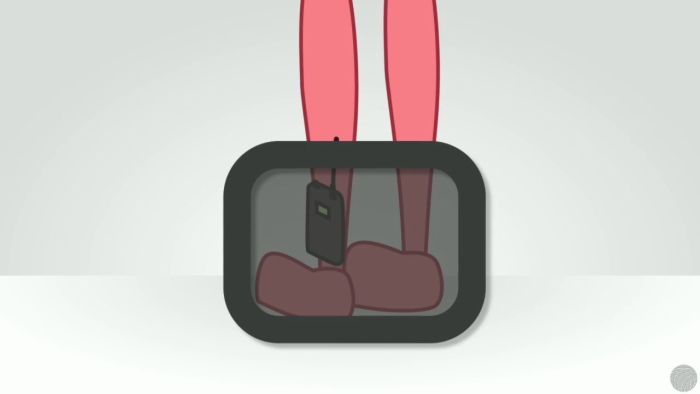

O aparelho de transmissor ao qual os microfones estão conectados também pode precisar ser escondido sob as roupas de uma pessoa. Boas áreas para esconder o transmissor seriam ao redor da cintura, no espaço criado na coluna logo acima da linha da cintura:

Na coxa sob uma saia ou vestido:

Nos tornozelos sob a perna da calça ou mesmo dentro de uma bota:

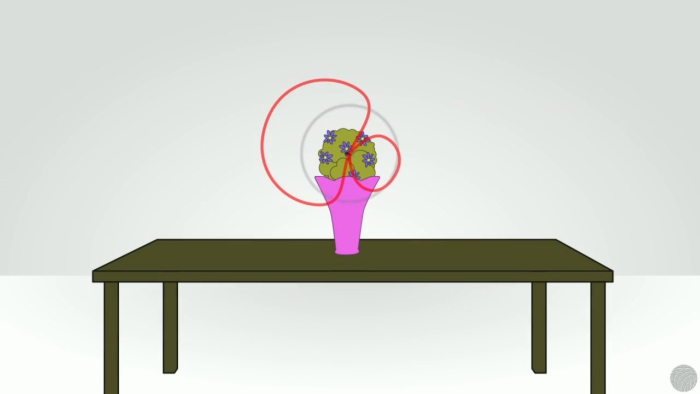

3. Lapelas como microfones plantados

Além de serem usados nas pessoas, certos microfones lapela também são úteis se você estiver usando como microfones plantados. Um microfone plantado é normalmente colocado em um local escondido no set para captar pessoas como um reserva ou em vez de um microfone boom. Portanto, se você ver uma mesa redonda ou mesa de jantar montada, o mixer de som pode estar cobrindo a cena com um ou mais microfones plantados escondidos na peça central da mesa.

Os microfones plantados também podem entrar em ação quando cenas movimentadas são filmadas com Steadicam ou lodge dolly, onde pode ser impraticável fazer com que o operador de boom tente seguir a câmera. Outro exemplo pode ser que as restrições do figurino tornem o uso de lapelas montadas no corpo difícil ou impraticável.

4. Lapelas com fio x sem fio

Um lapela com fio é a solução perfeita para circunstâncias controladas: em ambientes internos, filmagens em locais fixos, como uma entrevista sentada ou um novo cenário. Os lapelas com fio, em sua maioria, soam melhor do que os lapelas sem fio e também são ótimos backups se você tiver problemas de interferência com as versões sem fio.

Os lapelas sem fio têm várias vantagens e desvantagens. Uma das vantagens de um microfone sem fio é a liberdade de movimento que proporciona à pessoa que está falando, você também pode dispensar os problemas de cabeamento, por essas razões os lapelas sem fio são ideais para reality shows.

As desvantagens dos lapelas sem fio são:

- o alcance limitado

- interferência de equipamento de rádio

- e dependem de energia da bateria.

Confira também: Como operar um microfone boom? 5 dicas para melhorar o áudio do seu filme

Gostou das nossas dicas de como usar lapela? Deixe um comentário abaixo sobre o nosso texto e não esqueça de compartilhar o post com seus amigos.

Acompanhe outras dicas de audiovisual e cinema aqui no nosso site.

O post Como usar lapela? 4 Dicas essenciais para usar o microfone de forma certa apareceu primeiro em Luz, Câmera e ação! .

]]>O post Principais softwares de edição de áudio para cinema — 2020 apareceu primeiro em Luz, Câmera e ação! .

]]>Na verdade, alguns softwares são mais adequados para mixar e editar áudio para filmes e vídeos, gravar e editar ADR e / ou inserir efeitos sonoros e Foley, além de funcionar bem para composição musical e sons em loop. Neste artigo, veremos os melhores softwares de edição de áudio para cinema (via Videomaker).

Melhor software de edição de áudio para iniciantes

Magix SOUND FORGE Audio Studio 14

Prós:

- Preço acessível

- 5.1 surround sound

Contras:

- Focado principalmente na produção musical

Embora o nome possa não ser tão familiar para editores que usam produtos Adobe, AVID ou Apple, o Sound Forge existe há 25 anos. Resumindo, recursos como ferramentas de restauração de áudio, extensão de tempo e manipulação de pitch tornam este software atraente para o editor de vídeo. Outros recursos úteis incluem one-touch recording, uma ferramenta de análise de espectro e uma nova Event Tool que deve oferecer uma experiência de edição mais flexível. A interface do Audio Studio é totalmente ajustável com quatro tons diferentes: escuro, médio, claro e branco.

Magix Audio Studio 14 também inclui iZotope Ozone Elements, o que é uma ótima vantagem. Este software suporta os formatos FLAC e AAC e até seis canais de áudio por projeto, permitindo a edição de 5.1 surround sound completo.

O Sound Forge Audio Studio 14 é vendido por R$ 200,00. Uma versão de teste gratuita da versão Studio também está disponível. Confira mais detalhes aqui.

Melhor software de edição de áudio para profissionais

Adobe Audition CC

Prós:

- Ferramentas de restauração de áudio

- Capacidades de multitrack

- Integração com o Creative Cloud

Contras:

- Requer assinatura mensal

Um dos maiores pontos fortes do Audition são suas habilidades de restauração de áudio. No entanto, também pode ser usado para gravar e editar clipes musicais. A versão mais recente adiciona novas ferramentas DeNoise e DeReverb, bem como melhorias gerais na interface e gerenciamento multitrack.

O Audition também tem a vantagem de ser fornecido com a Adobe Creative Cloud. Se você já tem uma assinatura do Adobe CC para seu poderoso pacote de softwares, o Audition é um grande bônus que você deve experimentar. O Adobe CC permite que você mova facilmente projetos do Audition para o Premiere e vice-versa, o que pode fazer com que sua pós no geral seja um processo muito mais rápido. Também é importante observar que Audition tem uma assinatura mensal autônoma se você não planeja usar outras ofertas da Adobe.

Atualmente, você pode obter o Adobe CC completo por R$224,00/mês ou pagar R$90,00/mês apenas pelo Audition. A Adobe também oferece um teste gratuito completo de sete dias sem a necessidade de cartão de crédito. Adobe Audition é compatível com Mac e PC. Confira mais detalhes aqui.

Melhor Plug-in

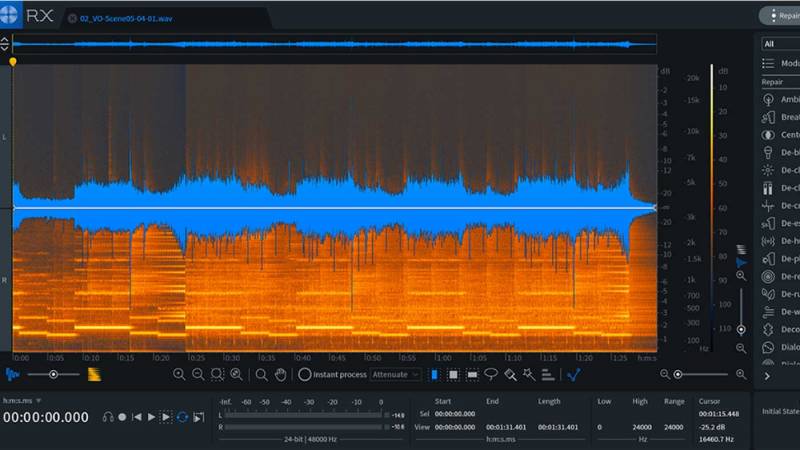

iZotope RX 7 Standard

Prós:

- Amplo conjunto de ferramentas de restauração de áudio

- Ampla compatibilidade com outros programas

- Preços flexíveis

Contras:

- O assistente de reparo cobre problemas limitados

iZotope RX 7 é um plug-in de edição de áudio conhecido por seus impressionantes recursos de restauração. Um extenso conjunto de ferramentas – com ferramentas como De-ess, De-plosive, De-reverb e Voice De-noise e muito mais – oferece muita flexibilidade para editar, reparar e aprimorar áudio imperfeito. Um Repair Assistant automatizado ajuda a detectar problemas com seu áudio e a oferecer soluções para alguns deles.

Como outras marcas, a iZotope oferece suítes de áudio cujas ferramentas e recursos aumentam em proporção ao preço. Você pode economizar algum dinheiro se precisar apenas de algumas das ferramentas disponíveis. Dito isso, você deve observar a diferença nas ferramentas de cada versão para decidir qual programa é o certo para você.

Como um plug-in, é compatível com programas hospedeiros, incluindo Adobe Audition e Premiere Pro CC e Final Cut Pro X, bem como outros softwares populares de edição de áudio com foco em música. Além disso, ele também pode funcionar como um editor de áudio independente. O RX 7 Standard custa $399. Também está disponível o RX Elements por $129 e o RX 7 Advanced por $1.199. Confira mais detalhes aqui.

Melhor software de edição de áudio gratuito

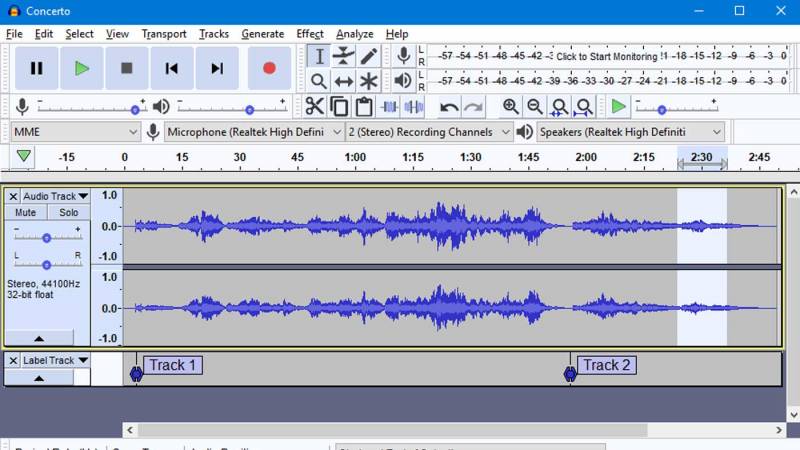

Audacity

Prós:

- Gratuito

- Expande recursos com plug-ins

- Suporte da comunidade de código aberto

Contras:

- Apenas faz edição destrutiva

O Audacity é um software de edição de áudio rápido e de código aberto que também é muito fácil de usar. Algumas pessoas não gostam e não consideram um verdadeiro DAW porque é um editor destrutivo de arquivos; no entanto, com o gerenciamento de arquivos correto, isso não é um problema.

O Audacity pode gravar e editar samples de 16 bits, 24 bits e 32 bits a uma taxa de amostragem de até 96 KHz e pode importar uma ampla variedade de formatos de arquivo. O software tem uma ampla gama de ferramentas incluídas, mas pode ser expandido com plug-ins para maior integração com outros programas ou para adicionar novos efeitos.

Existem Undo (e Redo) ilimitadas, e o único limite para o número de faixas que você pode editar e mixar são os limites do processador e da RAM do seu computador. Este software gratuito também tem alguns plug-ins bons. FFmpeg, por exemplo, permite que você edite seu áudio em sincronia com seu arquivo de vídeo. Se você está procurando um software livre que pode funcionar com um sistema mais antigo, esta é uma boa opção. Audacity é compatível com Windows, Mac OS ou Linux. Confira mais detalhes aqui.

Porque ter um dos softwares de edição de áudio?

Você pode fazer muitos trabalhos de áudio diretamente no software de edição de vídeo, mas quando precisar de ferramentas mais especializadas, um programa de edição de áudio separado pode realmente ser útil. Além disso, se você atingiu os limites de suas ferramentas de áudio integradas, pode ser hora de procurar uma solução mais robusta.

O que seu sistema de edição suporta?

O primeiro passo para encontrar o software de edição de áudio certo para você é considerar o hardware do seu computador. Dito isso, alguns softwares de áudio requerem mais potência do processador do que muitos pacotes de edição de vídeo. Além disso, há uma chance de que sua placa de áudio também precise ser atualizada. Um dispositivo de áudio externo pode ser uma solução fácil para isso. Outros fatores, como o sistema operacional do seu computador, também podem ser um fator, já que alguns DAWs são específicos para um sistema operacional. Na verdade, alguns desses programas de edição de áudio são específicos até mesmo sobre a versão desse sistema operacional. Por exemplo, o programa pode funcionar no Windows 7, mas não no Windows 10. Da mesma forma, se você estiver considerando um plug-in de edição de áudio, certifique-se de que seja compatível com o software host de sua preferência.

Alguns softwares de edição de áudio são mais especializados do que outros, portanto, considere cuidadosamente como suas necessidades correspondem aos recursos do software antes de comprar.

Antes de comprar

Com todas essas opções de software, há muitos recursos em comum. No entanto, também existem algumas ferramentas exclusivas específicas para cada software. Infelizmente, havia muitos recursos para cada programa para listar neste artigo.

A maioria dos editores considera o uso de uma DAW quando há um problema específico com um projeto que eles precisam resolver. Portanto, o recurso que fornece essa solução pode ser o que mais influencia sua compra. Mas os editores de vídeo geralmente continuam a usar sua DAW para maior controle de áudio. No final das contas, não existe uma única melhor DAW; o melhor DAW para você será aquele que se adapta às suas necessidades e ao seu orçamento.

Confira também: O que é som no audiovisual?

Qual dos softwares de edição de áudio você gosta mais? Deixe um comentário abaixo e não esqueça de compartilhar o post com seus amigos.

Acompanhe outras dicas de audiovisual e cinema aqui no nosso site.

O post Principais softwares de edição de áudio para cinema — 2020 apareceu primeiro em Luz, Câmera e ação! .

]]>O post Fundamentos de equalização de som: Como resolver problemas no seu áudio apareceu primeiro em Luz, Câmera e ação! .

]]>Nesse texto vamos te mostrar como lidar com harmônicos recorrentes, como realçar ou domar frequências específicas para vozes masculinas e femininas e até mesmo algumas técnicas básicas para salvar diálogos gravados à distância (via moviola.com).

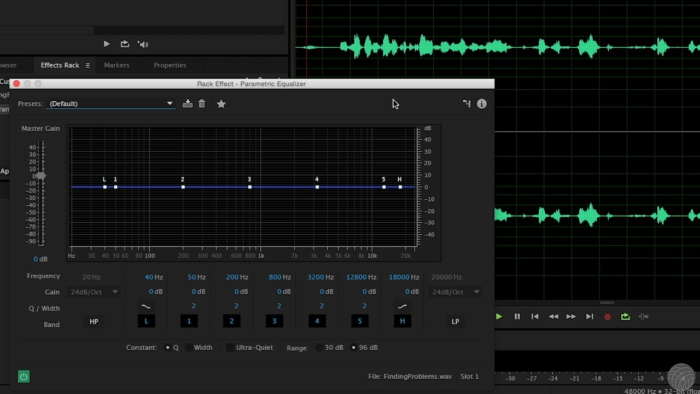

Fundamentos de equalização de som: Solucionando problemas de som

É muito comum que uma fonte de áudio tenha frequências desagradáveis devido às limitações do equipamento de gravação, à proximidade do microfone da fonte ou às propriedades acústicas do próprio aparelho. O desafio passa a ser determinar exatamente quais frequências estão causando os problemas.

A boa notícia é que existe um processo simples para encontrar esses problemas:

- comece criando um filtro em seu equalizador paramétrico com um sinal de entrada estreito

- Aumente o controle de ganho para um nível significativo

- Agora vasculhe as frequências do filtro em todo o espectro até que o tom problemático se torne proeminente.Normalmente os ruídos e os vocais se manifestam entre 2,5 e 4 quilohertz.

Parabéns, você identificou com sucesso a frequência que está causando o problema. A solução agora é cortar o ganho em vez de aumentá-lo, e então ajuste o sinal de entrada até que suficientes frequências em volta sejam cortadas para corrigir o problema. Provavelmente, você vai querer brincar com o ganho e com o sinal até que tenha acertado em cheio. Repita isso para quaisquer outras frequências ruidosas. Perturbações sonoras e vozes masculinas costumam estar em torno de 250 a 350 Hertz, então tente cortar aqui se a voz estiver soando turva.

Uma dica importante ao cortar frequências é que um som frequentemente ocorrerá em vários pontos diferentes no espectro de frequência. Quando as notas musicais aumentam em uma oitava, a frequência dobra porque as fontes de som geralmente incluem tons harmônicos além do som fundamental. Às vezes você pode corrigir problemas observando os múltiplos da frequência fundamental para remover esse zumbido da linha de alimentação. Nos Estados Unidos é aumentada a frequência em 60 Hertz, então é preciso atingir múltiplos harmônicos de 60.

Em vez de fazer as contas em sua cabeça, ferramentas como a Adobe fazem isso para você. Você apenas escolhe quantos harmônicos você precisa colocar para resolver o problema. Isso pode causar alguns problemas com a equalização do diálogo, mas podemos ajustar a equalização do som um pouco mais depois, e é muito melhor do que ouvir o zumbido no áudio.

Vamos usar como exemplo um grilo desagradável ameaçando destruir uma entrevista inteira. Ao aprimorar as frequências específicas onde o som dos grilos é ouvido, podemos eliminá-los sem afetar drasticamente a qualidade do diálogo da entrevista.

Com isso uma nova categoria de edição de áudio surgiu nos últimos anos, a edição de frequência permite que os engenheiros de áudio excluam porções do espectro de frequência que estão causando problemas. Deixando outras fontes de som quase intactas. O iZotope é o mais famoso desses tratamentos de plug-in, mas aplicativos como o Adobe Audition têm sua própria versão desse tipo de edição de frequência.

Removendo problemas de frequências

Uma técnica importante ao trabalhar com áudio é remover as frequências de base, o som de baixa intensidade pode se acumular, causando todos os tipos de problemas em uma mixagem. Para muitas vozes humanas, as frequências abaixo de 300 Hertz não contribuem significativamente para o timbre vocal ou tom geral. O que vai ocupar essas frequências é o ruído do vento ou batidas acidentais no microfone.

Se você deixar esses sons graves, muitas vezes pode acabar com graves sujos em sua mixagem. Ao eliminar os graves usando um filtro passa-altas, você realmente só perde sons indesejados. Agora, é claro, se você estiver mixando alguém como James Earl Jones, deve tomar cuidado para não perder a tonalidade ao tirar as mais baixas.

Normalmente, qualquer coisa abaixo de cerca de 100 Hertz pode ser cortada com segurança, os subwoofers profissionais operam a 80 Hertz ou menos, então você vai querer salvar esta faixa de frequência para mexer nos efeitos do ambiente e nas linhas baixas vibrantes.

A melhor solução para implosivos de irmãos é tipicamente montar os níveis de áudio, mas em situações mais severas, equalizar pode ser necessário. Para aliviar as vozes de irmãos e mulheres, tente atingir a faixa de 06 a 08 quilohertz. Para os homens, utilize a faixa de 04 a 06 quilohertz. Novamente vasculhe para encontrar a frequência desagradável e depois a corte, mas não corte muito, senão você deixará o ator balbuciando e terminará com uma carta oficial desagradável de seu agente.

Aumentando as frequências

Ok, já vimos como remover frequências problemáticas, mas e quanto a aumentar as frequências para moldar o som? Vamos dar uma olhada em algumas diretrizes úteis para adicionar impacto às suas trilhas de diálogo.

Como mencionamos anteriormente, tons ásperos de vozes são normalmente encontrados entre 2,5 e 4 kilohertz, então você tem que adicionar muito aqui, um aumento acima de 6 kilohertz te dará uma leveza ou nitidez à mixagem sem tornar as coisas desagradáveis. Use um sinal de entrada amplo e não exagere, vasculhe a frequência para encontrar o melhor Centro.

E falamos sobre tirar as baixas para evitar uma mixagem suja, mas e se você quiser enfatizar isso intencionalmente? Você pode adicionar profundidade a uma trilha de voz aplicando um aumento na faixa de 150 a 600 Hertz, mantenha o sinal de entrada bastante estreito e não exagere, você deve testar a trilha sonora resultante em um sistema com um grave poderoso para ter certeza de que você não está sobrecarregando o mix. Na extremidade inferior, em torno de 150/160 Hertz, você pode adicionar um impacto significativo às vozes masculinas ou engrossar a feminina.

Trabalhando com diálogo

Para melhorar o diálogo de maneira geral, tente aumentar em torno de 2,5 quilohertz. Lembre-se de que esta é uma área comum para aspereza, então seja sutil com o impulso e use-o com um sinal de entrada generoso. E para adicionar o que se chama de presença ao diálogo, trabalhe com frequências em torno de 5 quilohertz.

Esses são alguns dos princípios gerais para ajudá-lo a encontrar e corrigir problemas ou melhorar o som de seu diálogo, mas antes de encerrarmos, vamos examinar um problema muito comum: Diálogo distante.

A menos que um boom seja mantido muito próximo da fonte de som, a gravação de som resultante começa a perder a definição rapidamente, o resultado será um áudio potencialmente ruidoso. Como último recurso antes de recorrer à dublagem, tente cortar as frequências em torno de 300 Hertz com um sinal de entrada diagonal para remover os graves excessivos. E então tente aumentar em torno de 4 quilohertz com um sinal de entrada largo para limpar a mixagem.

Estamos chegando ao fim, mas antes é bom deixarmos claro que seu estúdio de som é fundamental para o sucesso de sua mixagem, isso é ainda mais verdadeiro para o trabalho de equalização. Se seu ambiente de escuta e monitores não forem neutros, seu trabalho de equalização pode estar completamente fora do ideal.

Conclusão

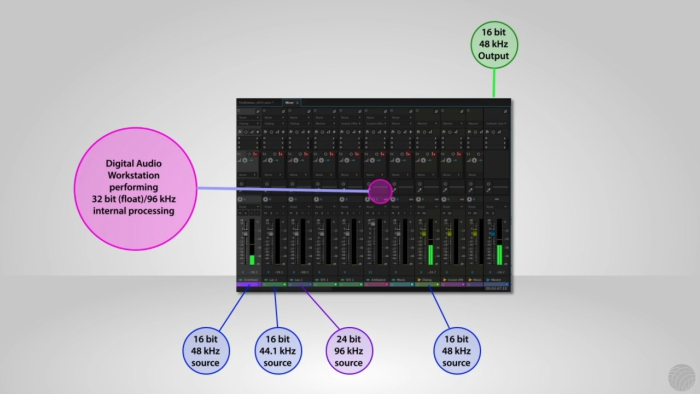

Vamos recapitular, o som é feito de amplitude e frequência, equivalente ao volume e tom na linguagem coloquial. A audição humana está normalmente na faixa de 20 Hertz a 22 quilohertz. A frequência de uma amostra digital precisa ser o dobro da frequência mais alta que deve ser representada, e a profundidade de bits determina quantos passos e volume podem ser representados. Um padrão comum da indústria é 24 bits 96k low hertz, embora 48 kilohertz seja comum como formato de gravação.

As equalizações vêm em duas formas comuns: gráfica e paramétrica. Um equalizador paramétrico típico inclui três filtros de controle:

- a frequência central

- o ganho

- sinal de entrada.

Os equalizadores paramétricos também geralmente contêm filtros passa-altas e baixas e controles shelving. Sempre equalize no contexto de toda a mixagem para evitar a criação de uma trilha sonora desequilibrada. Para corrigir o tom indesejado no som, configure um filtro paramétrico para um ganho alto e sinal de entrada estreito e vasculhe o espectro para a localização do tons indesejados, então ajuste o ganho e o sinal de entrada apropriadamente.

Corte as frequências baixas abaixo de 300 Hertz para evitar um acúmulo de ruídos na mixagem. E faça ajustes em frequências específicas para adicionar calor e força aos vocais, ou para eliminar problemas como posicionamento distante do boom.

Confira também: O que é som no audiovisual?

O que achou dos principais fundamentos da equalização do som? Deixe um comentário abaixo e não esqueça de compartilhar o post com seus amigos.

Acompanhe outras dicas de audiovisual e cinema aqui no nosso site.

O post Fundamentos de equalização de som: Como resolver problemas no seu áudio apareceu primeiro em Luz, Câmera e ação! .

]]>O post Fundamentos da compressão do som: Aprenda a aproveitar os efeitos dinâmicos apareceu primeiro em Luz, Câmera e ação! .

]]>Por que comprimir?

A compressão pode ser usada para massagear sutilmente uma faixa para torná-la mais natural e audível sem adicionar distorção, resultando em um diálogo que é mais “confortável” de ouvir. Além disso, muitos compressores – tanto de hardware quanto de software – terão um som característico que pode ser usado para injetar coloração e tom maravilhosos em áudios sem vida.

Mas compactar demais seu áudio pode realmente tirar a vida dele. Ter um bom conhecimento do básico te ajudará muito a entender como a compressão funciona e como usá-la com confiança em sua vantagem.

Controles e parâmetros comuns da compressão do som

Dependendo de qual compressor você está usando, e se é uma unidade de hardware ou um plug-in, existem alguns parâmetros e controles comuns que você usará para ditar o comportamento do efeito de compressão. Abaixo estão alguns dos elementos básicos da compressão. Seu compressor pode ou não incluir todos eles, mas entender o que cada um faz permitirá que você trabalhe confortavelmente com uma ampla variedade de compressores.

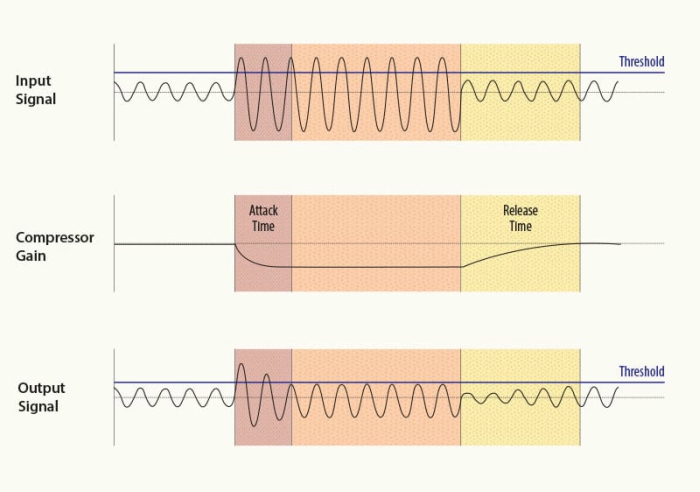

Threshold

O controle de threshold define o nível em que o efeito de compressão é ativado. Somente quando um nível ultrapassar o threshold, ele será compactado. Se o nível de threshold for definido em, digamos, -10 dB, apenas os picos de sinal que se estendem acima deste nível serão comprimidos. No resto do tempo, nenhuma compressão acontecerá.

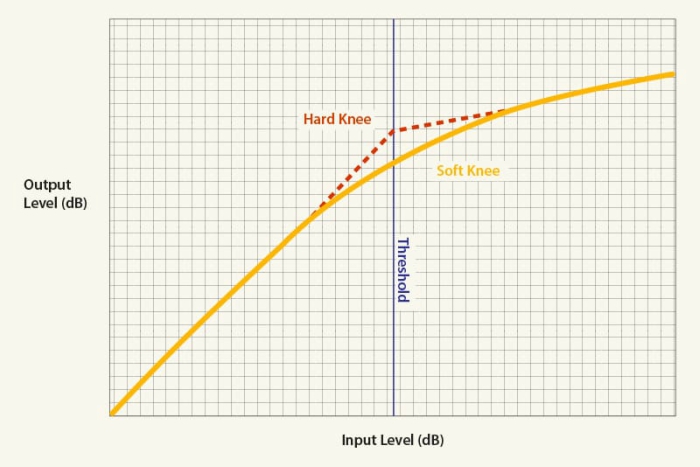

Knee

O “knee“ refere-se a como o compressor faz a transição entre os estados não compactado e compactado de um sinal de áudio que passa por ele. Normalmente, os compressores oferecem um, ou em alguns casos, uma escolha comutável entre os dois, uma configuração de “soft knee” e “hard knee”. Alguns compressores permitem até mesmo controlar a seleção de qualquer posição entre os dois tipos de knees. Como você pode ver no diagrama, um “soft knee” permite uma compressão mais suave e mais gradual do que um “hard knee”.

Attack

Esse se refere ao tempo que leva para o sinal ficar totalmente comprimido após exceder o nível de threshold. Os tempos de attack mais rápidos são geralmente entre 20 e 800 us (microssegundos), dependendo do tipo e marca da unidade, enquanto os tempos mais lentos geralmente variam de 10 a 100 ms (milissegundos). Alguns compressores expressam isso como inclinações em dB por segundo, e não no tempo. Tempos de ataque rápidos podem criar distorção ao modificar formas de onda de baixa frequência inerentemente lentas (por exemplo, se um ciclo a 100 Hz dura 10 ms, então um tempo de ataque de 1 ms terá tempo para alterar a waveform, o que gerará distorção).

Release

Esse é literalmente o oposto do attack. Mais especificamente, é o tempo que leva para o sinal ir do estado comprimido – ou atenuado – de volta ao sinal não comprimido original. Os tempos de release serão consideravelmente mais longos do que os tempos de attack, geralmente variando de 40-60 ms a 2-5 segundos, dependendo de qual unidade você está trabalhando. Às vezes, eles também podem ser referenciados como inclinações em dB por segundo em vez de tempo.

A operação normal do compressor será definir o tempo de release para ser o mais curto possível, sem produzir um efeito de “bombeamento”, que é causado pela ativação cíclica e desativação da compressão. Por exemplo, se o tempo de release for definido muito curto e o compressor estiver alternando entre ativo e inativo, seu sinal dominante também modulará seu nível de ruído, resultando em um efeito de “respiração” distinto .

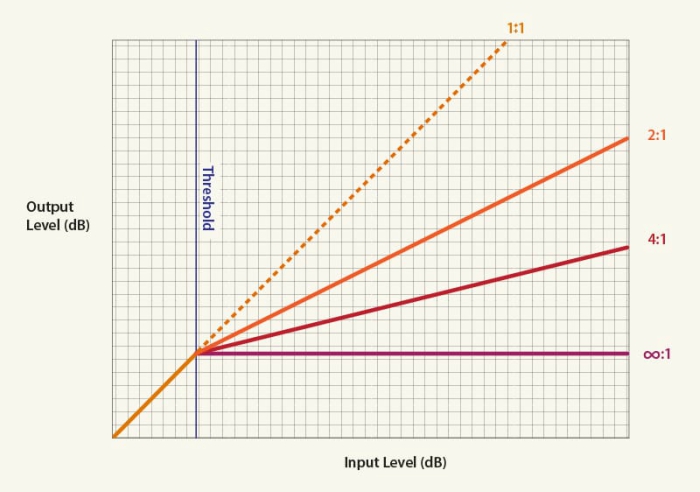

Ratio

Freqüentemente mal interpretado, o ratio de compressão simplesmente especifica a quantidade de atenuação a ser aplicada ao sinal. Você encontrará uma ampla gama de ratios disponíveis, dependendo do tipo e fabricante do compressor que estiver usando. A proporção de 1:1 (um para um) é a mais baixa e representa “ganho unitário”, ou seja, sem atenuação. Esses ratios de compressão são expressos em decibéis, de modo que uma razão de 2:1 indica que um sinal que excede o threshold em 2 dB será atenuado até 1 dB acima do threshold, ou um sinal que excede o threshold em 8 dB será atenuado para baixo a 4 dB acima dele, etc.

Um ratio de cerca de 3:1 pode ser considerada compressão moderada, 5:1 seria compressão média, 8:1 começa a entrar em compressão forte e 20:1 (vinte para um) até ∞:1 (infinito para um) seria considerado “Limitando” pela maioria e pode ser usado para garantir que um sinal não exceda a amplitude do threshold.

Ganho de saída

Embora a compressão seja geralmente usada para tornar o sinal mais alto, na realidade a atenuação induzida por compressão está diminuindo a saída. É aqui que o “ganho de saída”, ou “ganho de make-up”, entra em jogo. Você pode usar o ganho de saída para “compensar” a atenuação feita pelo compressor. Alguns compressores fornecem medidores que podem ser colocados no modo “GR” ou “redução de ganho” para indicar visualmente a atenuação total em dB, permitindo que você aplique com precisão a quantidade correta de ganho de saída.

Confira também: Como operar um microfone boom? 5 dicas para melhorar o áudio do seu filme

E aí gostou dos efeitos de compressão do som? Deixe um comentário abaixo e não esqueça de compartilhar o post com seus amigos.

Acompanhe outras dicas de audiovisual e cinema aqui no nosso site.

O post Fundamentos da compressão do som: Aprenda a aproveitar os efeitos dinâmicos apareceu primeiro em Luz, Câmera e ação! .

]]>O post Como operar um microfone boom? 5 dicas para melhorar o áudio do seu filme apareceu primeiro em Luz, Câmera e ação! .

]]>Costuma-se dizer que você pode perceber se um filme é amador ouvindo ele mesmo sem vê-lo, e a razão pela qual isso é dito com tanta frequência é porque é absolutamente verdadeiro.

Nas próximas linhas, falaremos do cerne da captura de um bom áudio no set de filmagem. Com apenas alguns passos simples você poderá alterar drasticamente a maneira como as pessoas percebem a qualidade do seu filme. Vamos começar com a nossa primeira dica de como operar um microfone boom (via moviola.com).

1. Posição do microfone

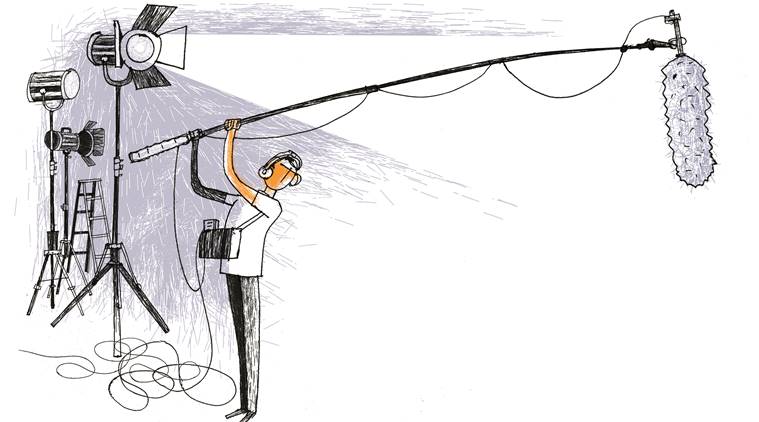

O operador de boom utiliza a técnica de suspender um microfone acima de um ator, permitindo versatilidade e movimento do ator, ao mesmo tempo que mantém uma excelente qualidade de áudio.

A regra nº 1 para gravar diálogos profissionais em locações é colocar o microfone o mais próximo possível da boca do ator, mantendo uma boa resposta de frequência. Para obter o posicionamento do microfone de uma forma que ele não apareça, é necessário marcar o posicionamento da equipe antes de começar a filmar. Com a ajuda do cinegrafista e do diretor, o operador de boom deve saber exatamente quais movimentos de câmera e do ator irão ocorrer. O processo de posicionamento da equipe elimina a entrada da vara no quadro da câmera, as sombras dela e possíveis movimentos descoordenados.

2. Direcionando o boom

A direção para onde você aponta o microfone é importante. Os microfones boom têm padrões de captação altamente direcionais, isso significa que eles captam mais do som na área estreita para a qual estão apontados e rejeitam mais do som que está fora desta região.

Quando um microfone boom não está apontado para a fonte do diálogo, é referido como estando fora do eixo e resulta em um som distante indesejável que é o tipo de áudio que categoriza filmes amadores.

Apontar o microfone para a fonte ou mantê-lo no eixo proporciona resultados muito melhores.

Como os atores costumam ser bastante expressivos, se você direcionar o boom diretamente para a boca deles, você corre o risco de grandes mudanças de nível conforme o ator move a cabeça. Em vez disso, mire em direção ao tórax, isso lhe dará um tom e nível de som muito mais consistentes.

Na maioria das vezes, você vai inclinar a vara por cima do ator, mas ocasionalmente, por motivos criativos ou problemas de iluminação, você pode escolher posicionar o boom abaixo do ator, fora do enquadramento:

Capturar uma voz por baixo pode produzir um som mais profundo do que na posição de boom por cima, uma vez que o microfone está mais perto do peitoral. Essa pode ser uma forma eficaz de enfatizar a força de um personagem masculino, por exemplo.

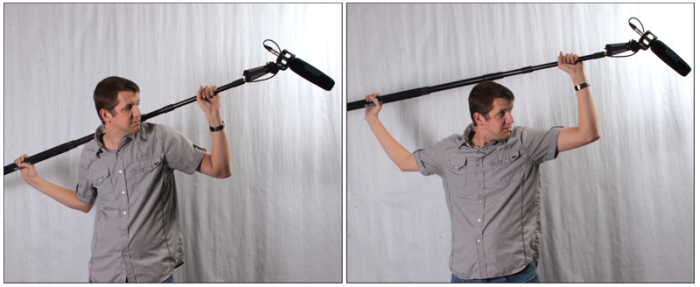

3. Postura

A maneira como você se posiciona ao operar um microfone boom é essencial, já que você pode ter que segurar uma vara por muitos minutos seguidos. Reduza a fadiga segurando a vara em uma pose H relaxada. Manter os braços muito afastados produzirá muito mais fadiga muscular. Ao mesmo tempo, evite a tentação de travar os cotovelos, o que afetaria sua capacidade de responder a mudanças repentinas na posição de um ator.

4. Como operar um microfone boom monitorando o áudio

O operador de boom monitora o som nos fones de ouvido e faz pequenos ajustes durante a filmagem, aprimorando o som para obter a melhor qualidade. Se a cena for compartilhada por vários personagens, o operador do boom move e gira suavemente o microfone conforme necessário para capturar todo o diálogo. Tudo isso segurando uma longa vara sobre a cabeça. Este trabalho é bem pesado e completamente subestimado. O monitoramento pelo fone de ouvido é crucial em qualquer situação e ajudará a determinar a melhor abordagem.

5. Gravando o áudio

Você deve sempre definir o nível de gravação bem no meio da capacidade do seu gravador. Em equipamentos digitais, o ponto ideal é cerca de menos 12 decibéis.

Use fones de ouvido para monitorar o nível, mas também consulte visualmente os medidores. Níveis muito baixos produzirão ruídos desagradáveis quando o volume do áudio for aumentado na pós. Mas se você definir seus níveis muito altos, a gravação soará distorcida sempre que o ator levantar a voz.

Em equipamentos digitais, o ideal é que o diálogo fique entre menos 20 e menos 12 decibéis. Tudo bem se o nível ocasionalmente ficar um pouco acima de -12 nas partes mais altas do diálogo, mas você não quer que nunca chegue a zero, se isso acontecer alerte a equipe para uma refilmagem assim que a tomada terminar.

O som ambiente é quando os atores não estão dizendo nada. Grave pelo menos 30 segundos de som ambiente usando o mesmo microfone na mesma posição de boom usada para gravar o diálogo. Isso significa 30 segundos separados para cada ator em cada posição no set onde eles estão dizendo suas falas. Você precisará do som ambiente mais tarde para suavizar as edições no som. Sem o som ambiente, o áudio oscilará entre os cortes, chamando a atenção do público para a edição, o que tirará rapidamente eles da imersão na história.

Conclusão

Obviamente, há muito mais para aprender sobre o áudio, mas essas poucas etapas o ajudarão num longo caminho no sentido de aperfeiçoar a trilha sonora de seu próximo filme. Vamos revisar o que falamos aqui:

- Comece colocando o microfone perto de sua fonte de som, encontre o limite do quadro de sua câmera e posicione a vara ligeiramente acima dele.

- Mantenha o direcionamento correto do microfone. Mantenha o microfone no eixo e geralmente direcione-o para o tórax do seu ator. Posicione os braços em uma pose em H, mas sem travar os cotovelos.

- Certifique-se de usar fones de ouvido durante a gravação. No gravador digital mantenha os níveis de diálogo oscilando entre menos 20 e menos 12 decibéis.

- E certifique-se de gravar o som ambiente exclusivo para cada posição do microfone no set.

Confira também: O que é som no audiovisual?

Gostou das nossas dicas de como operar um microfone boom? Deixe um comentário abaixo sobre o nosso texto e não esqueça de compartilhar o post com seus amigos.

Acompanhe outras dicas de audiovisual e cinema aqui no nosso site.

O post Como operar um microfone boom? 5 dicas para melhorar o áudio do seu filme apareceu primeiro em Luz, Câmera e ação! .

]]>O post O que é som no audiovisual? apareceu primeiro em Luz, Câmera e ação! .

]]>

O que é som no audiovisual? Todos sabemos que primeiramente os filmes eram mudos e depois houve o som. Mas essa não é a história toda. Antes da fala nos filmes, eles ainda eram ouvidos por meio de legendas e acompanhamento musical.

Hoje em dia o som é umas das partes essenciais de um filme, muitas vezes o cuidado com o som separa um filme amador de um filme profissional.

O som no filme inclui música, diálogo, efeitos sonoros, som ambiente e / ou ruído e soundtrack (via MasterClass). Sempre é usado algum tipo de som para aprimorar a experiência do filme.

Confira abaixo a definição de cada elemento que faz parte do som no audiovisual.

Música

Imagine um filme sem nenhuma música. Certas cenas, como os créditos iniciais, teriam um ar morto. Dá a impressão de estar faltando alguma coisa, a música é um elemento muito importante para um filme. No período do cinema mudo, a música era tocada durante todo o filme. A música no audiovisual é chamada de trilha sonora.

Você já fechou os olhos para ouvir música? Você pode sentir que está sendo levado pela música para uma terra onde o filme está ocorrendo.

A música também é tocada em pontos críticos durante um filme. Você já teve fortes emoções durante um suspense quando uma certa peça de música é tocada em diferentes pontos do filme? Sua adrenalina começa a disparar e seu coração começa a bater mais rápido durante esses pontos do filme, quando você ouve aquela música, porque sabe que algo vai acontecer? Se essas situações ocorrerem ao assistir a um filme, como a experiência do filme mudaria se a música não fizesse parte dele?

Diálogo

Diálogo é definido como uma conversa entre duas ou mais pessoas em um filme. Além disso, um filme pode ter um monólogo em que um personagem está falando em voz alta quando está sozinho. Um personagem, por exemplo, pode contemplar os prós e os contras de tomar alguma decisão em um monólogo.

Um filme também pode ter narração voice-over. A narração voice-over é quando um personagem explica o que acontece em um filme e porquê. Diálogo, monólogo e narração voice-over avançam a história do filme.

O que seria um filme sem diálogo? Até 90/ 100 anos atrás, havia filmes mudos sem diálogo no áudio, mas legendas com as falas eram usadas, e a música de fundo definia o tom da cena.

Efeitos Sonoros

Uma definição de efeito sonoro é “qualquer som, exceto música ou fala, reproduzido artificialmente para criar um efeito em uma apresentação dramática, como o som de uma tempestade ou uma porta rangendo.” Um filme de ação, por exemplo, é mais interessante e ousado com efeitos sonoros. Com efeitos sonoros o espectador se envolve mais com o filme.

Os efeitos sonoros são frequentemente adicionados na pós-produção do filme. Muitas vezes, ao filmar uma cena com várias ações acontecendo ao mesmo tempo, como diálogo, luta com espadas e outras ações em segundo plano, os efeitos sonoros são adicionados na pós-produção para deixar os sons mais altos.

Na produção audiovisual, podemos diferenciar os efeitos por sua origem:

Efeitos originais: são sons diretos da fonte. Estes têm a mais alta clareza e qualidade. Alguns exemplos seriam: ambientes, crianças correndo, carros em operação.

Efeitos de Foley: Seu nome vem de seu criador, George Foley. São sons gravados em ambientes controlados, que recriam ambientes ou efeitos naturais. Esses sons são gravados e arquivados para serem utilizados como efeitos sonoros em produções futuras.

Efeitos eletrônicos: Embora até 1970 os sintetizadores não tinham ainda se popularizado, desde 1930 são experimentos sons sintéticos.

Efeitos sonoros em 3D: A dimensão espacial do som. Perceptível apenas com fones de ouvido, é necessária uma gravação com um dispositivo de cabeça falsa que permita que a distância entre os microfones seja a mesma que entre nossos ouvidos. É usado cada vez mais na realidade virtual. Nós o usamos para dar mais realismo às nossas experiências mais imersivas.

Som ambiente (Som de fundo)

Sons ambientes são ruídos de fundo que estão em uma sala, em uma casa, fora dela ou em qualquer local. Todo local possui sons distintos e sutis criados por seu ambiente. Sons ambientes são tipos de efeitos sonoros.

Como um exemplo para experienciar o que é o som ambiente, fique em uma sala sozinha e não faça absolutamente nenhum barulho. Os ruídos da sala que você ouve é o som ambiente. Um quarto em uma casa mais antiga teria mais ruídos do que uma casa mais nova. Além disso, dependendo do bairro, você teria ruídos externos ao ambiente, dependendo de um local. A seguir, são apresentados exemplos de sons ambientes:

- vida selvagem

- vento

- chuva

- água corrente

- trovão

- farfalhar de folhas

- tráfego distante

- motores de aeronaves

- máquinas operando

- conversas abafadas

- ranger de pisos

- e ar condicionado.

O som de fundo dá ao filme mais realismo. Um personagem de filme percorre uma área arborizada à noite. Essa cena careceria de suspense se não houvesse ruídos ambientais.

O som das moedas na bolsa no início do filme Cyrano de Bergerac é um som muito importante porque produz um som como se houvesse muitas moedas na bolsa. Para esse efeito, o ruído ambiente teve que ser adicionado na pós-produção, porque esse som não seria capaz de ser ouvido ao filmar a cena.

O vídeo do YouTube a seguir, intitulado “Introdução ao Foley e efeitos sonoros para filmes”, apresentado e produzido pelo Filmmaker IQ, oferece uma boa demonstração de efeitos sonoros e ruídos do ambiente.

Soundtracks

Uma soundtrack é uma gravação de áudio criada ou usada na produção ou pós-produção de filmes. Inicialmente, o diálogo, os efeitos sonoros e a música em um filme têm suas próprias trilhas separadas (trilha de diálogo, trilha de efeitos sonoros e trilha musical), e elas são misturadas para formar o que é chamado de faixa composta, que é ouvida no filme.

Confira também: O que é Cinematografia?

Se interessou pela área de som no audiovisual? Comente abaixo.suas opiniões e compartilhe o post com seus amigos.

Acompanhe outras dicas de audiovisual e cinema aqui no nosso site.

O post O que é som no audiovisual? apareceu primeiro em Luz, Câmera e ação! .

]]>